Crédit photo : Unplash

La récente médiatisation de DeepSeek-R1, le nouveau modèle à chaîne de raisonnement développé par DeepSeek, a fait l’effet d’une onde de choc aux États-Unis de par ses résultats très prometteurs, rivalisant avec les champions américains (OpenAI, Anthropic, Claude notamment).

Rapidement, les modèles de DeepSeek se sont vus reprocher des biais manifestes par la presse sur des questions sensibles, telles que le rôle du Parti communiste chinois, la situation à Taiwan ou encore les événements de la place Tiananmen (The Guardian).

Ces biais, loin d’être nouveaux ou exclusifs à DeepSeek, sont connus et inhérent à ces modèles de langage.

Des acteurs américains majeurs comme OpenAI et Meta ont aussi été épinglés pour leurs préjugés sexistes (Le Monde) tandis que tout récemment xAI et son modèle Grok ont été pointés du doigt pour de fortes tendances climatosceptique (Theo Alves Da Costa).

La question se pose : comment peut-on garantir une intelligence artificielle digne de confiance ?

L’IA de Confiance repose sur un consensus mondial articulé autour de plusieurs piliers : la robustesse technique garantissant la fiabilité des algorithmes, le respect de la vie privée et une gouvernance transparente des données, la diversité et l’équité dans les représentations, le contrôle humain ainsi que la responsabilité environnementale et sociétale.

Pour appréhender ces défis et les appliquer au contexte actuel, il est essentiel de comprendre comment se construisent les modèles de langage actuels (dits LLM : Large Language Model). La première phase de leur élaboration consiste en un apprentissage massif, où des milliards (voir des billions) de contenus textuels sont exploités pour identifier des patterns linguistiques et des structures syntaxiques. Ce modèle de « fondation » prédit ensuite la probabilité d’un mot suivant dans une chaîne de texte.

Vient ensuite la phase d’instruction, qui affine le comportement du modèle pour le rendre apte à répondre de manière adéquate aux questions humaines et à éviter les dérives – telles que la reproduction de biais ou la formulation de réponses potentiellement nuisibles.

La qualité et la fiabilité d’un LLM dépendent donc, en grande partie, de ces 2 phases.

Certaines critiques portent notamment sur la provenance des données utilisées lors de l’entrainement des modèles d’OpenAI, des interrogations notamment soulevés par l’aspect éthique de la collecte et du respect des droits d’auteurs.

D’autre part, DeepSeek est soupçonné de censurer les questions pouvant critiquer le parti chinois, avec une information initialement affichée qui disparaît en fin de réponse.

Le marché des modèles de langage se divise aujourd’hui en plusieurs catégories.

D’une part, on retrouve des solutions propriétaires – comme celles d’OpenAI (avec ses modèles GPT), de Google (avec Gemini) ou d’Anthropic (avec Claude) –, dont l’accès et les algorithmes restent souvent opaques. D’autre part, des initiatives en Open-Weight, à l’instar de Meta avec son modèle LLAMA ou de Mistral, permettent aux utilisateurs de consulter l’architecture et, dans certains cas, d’affiner le modèle en fonction de besoins spécifiques. Enfin, les modèles véritablement Open-Source partagent l’intégralité de leur processus de création, des données d’entraînements aux choix architecturaux.

De plus, il est essentiel de baser le choix d’un LLM sur plusieurs critères :

- Robustesse technique (capacités de performance et résilience face aux vulnérabilités)

- Sécurité et conformité réglementaire (respect du RGPD, gestion des droits sur les données)

- Gouvernance (accès et traçabilité des processus d’apprentissage)

- Impact environnemental (consommation énergétique, empreinte carbone)

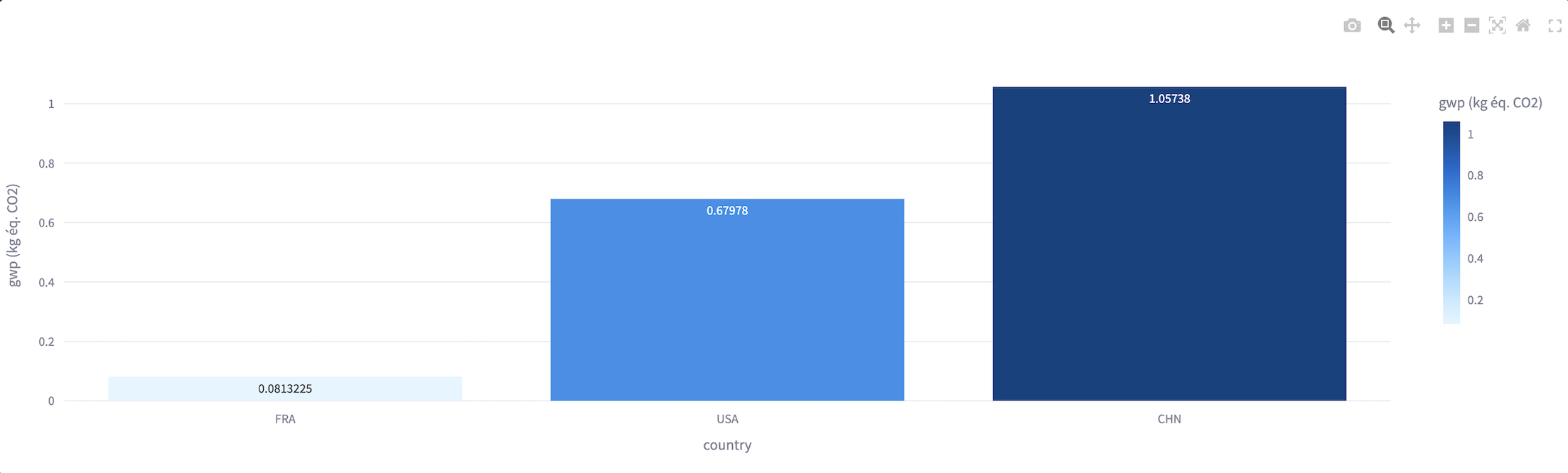

Nos études révèlent d’importantes disparités entre les fournisseurs de modèles de langage sur plusieurs dimensions clés, notamment l’impact environnemental, le coût financier et la conformité réglementaire.

L’analyse de l’empreinte carbone par requête – sur une tâche aussi simple que la reformulation d’un e-mail court – met en évidence des écarts significatifs entre les modèles. Par exemple, Gemini 2.0 Flash de Google affiche une consommation estimée à 1 gCO₂e par requête, contre 0,7 gCO₂e pour Llama 3 70B de Meta, tandis que Claude 3.5 Sonnet d’Anthropic atteint 131 gCO₂e, soit un facteur de 100 en plus (données issues de l’outil Ecologits). Ces disparités s’observent également au sein d’un même fournisseur : lorsque OpenAI a proposé son nouveau modèle très performant mais énergivore GPT-4 (68 gCO₂e par requête), tandis que le précédent GPT-3.5 Turbo s’avèrait 136 fois plus sobre (0,5 gCO₂e). Cette empreinte dépend aussi fortement du mix energétique des serveurs (et donc des pays).

En matière de coût financier, les écarts sont tout aussi marqués, notamment pour les utilisateurs d’API. Le prix par token peut varier d’un facteur de 200 entre certains modèles, Gemini étant l’un des plus économiques tandis que Claude figure parmi les plus onéreux. Cette variabilité doit être prise en compte lors du choix d’un LLM, en fonction des volumes de requêtes et des budgets alloués.

En matière de coût financier, les écarts sont tout aussi marqués, notamment pour les utilisateurs d’API. Le prix par token peut varier d’un facteur de 200 entre certains modèles, Gemini étant l’un des plus économiques tandis que Claude figure parmi les plus onéreux. Cette variabilité doit être prise en compte lors du choix d’un LLM, en fonction des volumes de requêtes et des budgets alloués.

Enfin, les exigences en matière de sécurité et conformité réglementaire diffèrent considérablement selon les fournisseurs. Les interactions avec DeepSeek sont potentiellement soumises à l’analyse des autorités chinoises, conformément aux lois de la République Populaire de Chine, tandis que Mistral garantit un hébergement sécurisé des données sur le territoire européen, en conformité avec le RGPD pour lui et ses partenaires.

Les décideurs doivent également évaluer la disponibilité et l’accessibilité du modèle (hébergement local ou externalisé, connecteurs/API) ainsi que son coût total de possession, afin d’opter pour une solution alignée sur leurs impératifs business, leur politique de sécurité interne et leur démarche RSE.

En outre, il est primordial d’avoir conscience du rythme élevé de sortie des fournisseurs. La question se pose de savoir s’il faut privilégier une architecture flexible, capable d’adopter rapidement de nouveaux modèles, ou opter pour une solution stable, dont les performances répondent durablement aux objectifs fixés de son cas d’usage.

Dans un contexte où les attentes sont fortes et les opportunités réelles, l’enjeu est bien d’en comprendre aussi les impacts et les risques : performance métier, économiques, technologiques, environnementaux et sociétaux.

À la croisée de nos compétences scientifiques et de nos engagements RSE, ce sujet est à nos yeux stratégique et nous accompagnons les organisations dans la formation, le choix et l’intégration de modèles adaptés à leurs priorités. N’hésitez pas à nous contacter pour en discuter !

Contact

Contact